Reseña crítica

¿Alguna vez se ha puesto a pensar que las máquinas que usamos a diario podrían ser tan prejuiciosas como los seres humanos?

Existe un mito muy extendido que dice que los algoritmos son herramientas matemáticas puras y, por tanto, incapaces de discriminar. Sin embargo, Tarcízio Silva rompe esa ilusión en este microbook. Él nos demuestra que la inteligencia artificial no es un ente abstracto que flota en el vacío: es un espejo de nuestra sociedad.

Si vivimos en un mundo con un racismo estructural profundo, las máquinas que diseñamos y los datos con los que las alimentamos van a terminar amplificando esas mismas injusticias. El mensaje central es directo y necesario: la tecnología no solo reproduce el racismo, sino que lo automatiza y lo vuelve invisible bajo una capa de "neutralidad técnica".

El autor sostiene que necesitamos una alfabetización algorítmica urgente. No basta con saber usar el celular: hay que entender cómo las decisiones de las plataformas digitales afectan de forma desproporcionada los derechos de las personas negras.

En estas páginas usted va a descubrir que el racismo algorítmico no es un "error de programación" que se arregla con un simple parche. Es un componente fundacional de cómo se extrae y se procesa la información en el siglo veintiuno. Este contenido lo va a preparar para cuestionar lo que parece "natural" en su feed de redes sociales y para entender los peligros de la vigilancia masiva.

Lo que usted gana con esta lectura es una visión crítica sobre el poder y la tecnología, lejos de la visión ingenua de Silicon Valley. Prepárese para descubrir cómo el diseño de una red social o un sistema de seguridad puede convertirse en una herramienta de opresión renovada si no intervenimos políticamente en su creación.

La Genealogía del Sesgo y la Vigilancia

Para entender por qué una máquina puede ser racista, hay que mirar hacia atrás.

Tarcízio Silva traza una línea entre las teorías eugenésicas del pasado y la recolección masiva de datos actual. El concepto de colonialismo de datos es clave aquí: explica cómo las grandes empresas tecnológicas extraen información de cuerpos racializados para alimentar sistemas de control, casi como se extraían materias primas en la época colonial.

El racismo no es un "bug": es una funcionalidad. Si el sistema está diseñado para clasificar y jerarquizar con base en datos históricos sesgados, el resultado siempre va a ser discriminatorio.

Uno de los campos donde esto se ve con mayor claridad es la visión computacional. Existen casos documentados donde el reconocimiento facial ni siquiera identifica rostros no blancos, o los asocia de forma equivocada con antecedentes criminales. El autor cita el estudio de Joy Buolamwini, que demuestra cómo la precisión de la inteligencia artificial se desploma cuando se analiza a mujeres de piel oscura. Eso no es solo una falla técnica: es un peligro real cuando esa tecnología se usa en la seguridad pública.

El policiamiento predictivo es otro terreno minado. Al usar algoritmos para decidir qué barrios vigilar, el sistema termina reforzando el perfilamiento racial en zonas periféricas, automatizando prejuicios policiales viejos bajo la excusa de la "eficiencia algorítmica".

Redes Sociales: Invisibilidad y Cánones de Belleza

Las redes sociales no son solo espacios de entretenimiento: son laboratorios de comportamiento donde la visibilidad está mediada por algoritmos que no siempre son justos. Silva explora cómo la economía de la atención moldea nuestra realidad digital.

Plataformas como Instagram o TikTok pueden "esconder" el contenido de activistas negros mediante el shadowban, mientras les dan prioridad a estéticas blancas y a contenidos menos conflictivos. Eso es visibilidad selectiva, y no es casualidad.

Los filtros de "belleza" que usamos a diario han sido entrenados bajo estándares eurocéntricos. Automáticamente aclaran la piel y afinan los rasgos, imponiendo un ideal de belleza que deja por fuera la diversidad racial.

También es fundamental cuestionar por qué las plataformas marcan con frecuencia el discurso antirracista como "contenido sensible" o "discurso de odio" cuando es denunciado masivamente, mientras permiten que discursos de odio disfrazados circulen libremente porque generan más interacciones.

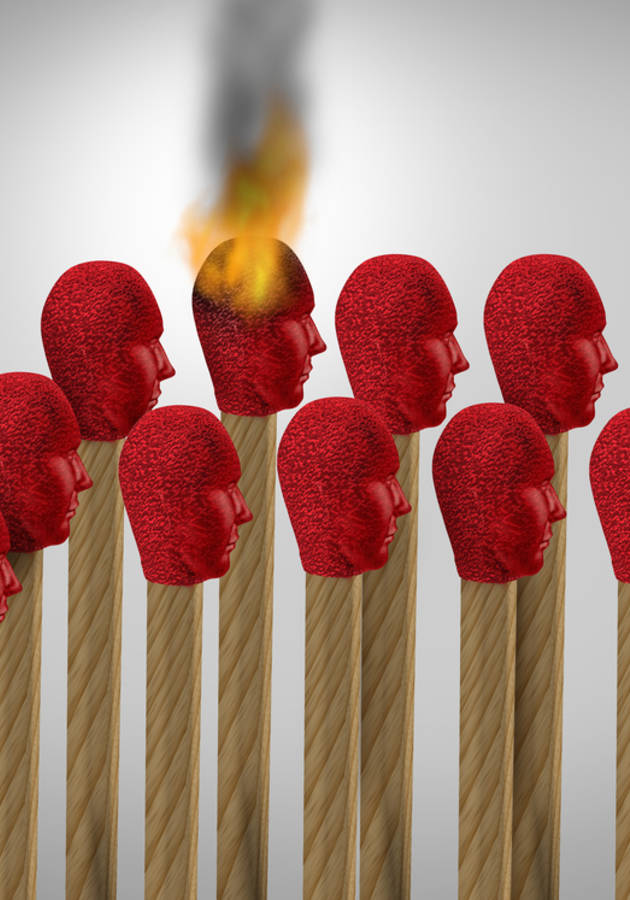

Y ahí está la raíz del problema. El modelo de negocio de las grandes empresas tecnológicas favorece lo inflamatorio. El contenido que genera odio o miedo retiene más tiempo al usuario en la pantalla, lo que produce más dinero en publicidad. Eso crea un terreno fértil para la radicalización y el crecimiento de burbujas de supremacismo blanco.

Resistencia y el Camino Hacia la Emancipación

Llegados a este punto, uno podría pensar que la batalla está perdida. Pero el autor propone vías de escape y de resistencia. La solución no es solo "arreglar el código": es cambiar quién tiene el poder sobre la tecnología.

El primer camino es la soberanía digital. Necesitamos desarrollar tecnologías que no sigan la lógica extractiva de las grandes corporaciones: infraestructuras que respeten la privacidad y la dignidad de las comunidades.

Silva también destaca la labor de tecnólogos y tecnólogas negros que están "hackeando" el sistema desde adentro y desde afuera. Los llama Informática Negra. No buscan solo una tecnología más eficiente, sino una tecnología que promueva la justicia social.

Y por supuesto, está la acción política. La lucha contra el racismo algorítmico requiere leyes de transparencia, auditorías externas de los algoritmos y, sobre todo, diversidad real en los equipos que diseñan estas herramientas.

La tecnología tiene que ser un campo de disputa política. No podemos dejar que el futuro de nuestra democracia se decida en cajas negras de código que nadie puede auditar. La emancipación digital pasa por entender que la inteligencia artificial debe servir para la liberación humana, y no para renovar formas de opresión viejas.

Notas Finales

"Racismo Algorítmico" es una lectura obligatoria para cualquier persona interesada en el vínculo entre tecnología y derechos humanos. Tarcízio Silva nos recuerda que los algoritmos no son neutrales porque nosotros no lo somos.

La gran lección es que la alfabetización algorítmica es una herramienta de resistencia ciudadana. Al entender cómo funcionan estos sistemas, dejamos de ser usuarios pasivos para convertirnos en actores políticos capaces de exigir una inteligencia artificial que respete la diversidad y la justicia.

¡Un consejo de 12minApp!

Para complementar este análisis sobre cómo la tecnología afecta a la sociedad, le recomendamos el microbook "Cointeligencia", de Ethan Mollick. Mientras Silva se enfoca en los riesgos y sesgos, Mollick explora cómo podemos colaborar con la inteligencia artificial de forma productiva. Leer los dos le va a dar una visión equilibrada: crítica con las fallas del sistema, pero preparada para aprovechar su potencial de forma ética. ¡Búsquelo en el catálogo de 12min!

Regístrate y lee gratis!

Al registrarse, tú ganarás un pase libre de 7 días gratis para aprovechar todo lo que el 12min tiene para ofrecer.